你是否也被这些问题折磨过?花了几个小时创作的AI视频,导出后却发现人物面部一直在“跳动”,物体凭空消失又出现,连调好色调在几帧之间也突然变了……

这,就是AI视频创作中最让人头疼的“跳帧”和“时序错乱”问题,几乎每个AI视频创作者,都曾被它逼到崩溃边缘。

但好消息是:这个问题并非无解。本文将为你系统性地拆解AI视频跳帧和时序不一致的根源,并提供时序一致性优化技巧,从基础到进阶,从工具实操到避坑指南,帮你解决AI视频跳帧问题。无论你是刚入门AI视频的爱好者,还是希望产出专业级作品的创作者,都能从本文中获取帮助,轻松避开误区,快速生成时序连贯、无跳帧的高质量AI视频。

一、先搞懂2个核心概念

想要解决跳帧和时序一致性问题,首先要明确两者的定义、表现与核心区别。很多创作者优化无效,本质是混淆了这两个概念,找错了问题根源,自然就会做无用功。

1.什么是AI视频跳帧?3种常见表现

在传统视频中,跳帧指帧率不足导致的卡顿。但AI视频中的"跳帧"指的是AI模型在帧间推理时出现的不连续、突变现象,与帧率高低没有直接关系。常见的3种表现如下:

① 面部/物体闪烁:人物的五官在不同帧之间出现变形、模糊或“抖动”,尤其是在转头、表情变化时尤为明显。背景中的物体也可能会出现忽大忽小、忽有忽无的情况。

② 运动瞬移:人物或物体位置随机跳跃,在画面中的运动轨迹不连贯,违反物理运动规律。

③ 光影突变:视频中光线的明暗、色调在不同帧之间发生剧烈变化,明明是同一场景,却看起来像在不同时间拍摄的。

2.什么是AI视频时序一致性?3个核心维度

“时序一致性”是视频帧与帧之间连贯程度的关键指标。一个时序一致性好的视频,应该满足以下三个维度:

视觉一致性:角色外观(大小、形状、比例等)、服装、颜色在相邻帧之间保持稳定。

动作一致性:物体的运动轨迹符合物理规律,运动轨迹流畅,没有突变、瞬移。

场景一致性:背景、光影(光源方向、强度、色温)、色彩、物理环境等前后统一。

二、追根溯源:AI视频跳帧 + 时序一致性差的核心成因

要解决问题,首先要找到根源。AI视频跳帧和时序一致性差,主要源于以下几个层面:

①技术层面

时序建模能力不足:模型难以准确捕捉帧间的运动轨迹与形变关系,尤其在复杂运动场景中,容易出现位置瞬移、形变突变。

潜空间不稳定:扩散模型在时间维度上的潜变量波动。

注意力机制局限:时序注意力权重分配不均。

②操作层面

提示词描述模糊:缺乏时序约束条件。

参数设置不当:帧率、步数、引导强度配置错误。

种子值随机性:未固定随机种子导致帧间差异。

③硬件层面

GPU显存不足:高分辨率(如4K)、长视频生成时,显存占用过高,导致模型推理中断、帧丢失。

推理速度波动:硬件性能不足时,每帧生成时间不稳定,长视频分段处理时容易出现“拼接痕迹”,间接引发跳帧感。

④场景层面

长视频生成:超过模型单次生成长度,分段拼接时没处理好。

高动态场景:模型难以捕捉时序关联,容易出现动作瞬移。

多物体场景:多物体同时运动时,模型难以兼顾所有物体的时序一致性,导致部分物体跳帧。

三、解决AI视频跳帧问题办法+时序一致性优化技巧

针对不同程度的问题,我们提供分层级的解决方案。你可以根据自己的实际情况,从基础开始逐步进阶。

1.基础优化技巧(针对轻度问题)

关键帧锁定技术:以高质量首帧为锚点,后续帧基于首帧生成,强制继承主体、场景特征。在AnimateDiff、Pika Labs等工具中,只需设置reference_strength=0.7-0.9即可显著提升一致性。

精准提示词优化:提示词不能笼统和模糊,需明确运动轨迹与节奏,分段描述复杂动作,添加时序关键词,正向提示词中加入稳定性关键词,负向提示词中加入抑制跳帧的关键词。

合理设置基础参数:包括帧率(24-30fps)、推理步数、引导强度(7-9)、帧间平滑度(0.8-0.95)。

2.进阶优化技巧(针对中度问题)

如果基础技巧效果不明显,或者你的视频涉及复杂场景,可以尝试以下进阶方案。

ControlNet结构锚定:结合ControlNet工具,为每一帧提供稳定的结构约束。

光流法插帧提升流畅度:生成原始视频后,使用插帧工具将其从原始帧率提升到30fps或60fps;插帧工具通过光流算法计算前后帧之间的运动轨迹,自动填补中间帧。

运动强度精细化调节:在支持运动强度调节的工具中,从较低值开始尝试,根据效果逐步微调,直到找到“运动感”和“稳定性”的最佳平衡点。

3.高级优化技巧(针对重度问题)

如果你的视频存在严重的跳帧问题,或者需要达到专业级质量标准,以下高级技巧值得尝试。

隐空间插值法:不直接生成每一帧,而是先生成少量“关键帧”;在潜空间中对关键帧进行线性或非线性插值,自动生成中间的过渡帧。

分层渲染与局部重绘:将视频拆解为背景层、前景人物层、道具层分别生成,利用工具,对跳帧最严重的区域进行局部重绘,再后期合成各层。

分段生成+智能拼接:将长视频拆分为多个短片段分别生成,在分段处设置重叠帧,后期再平滑拼接。

四、效果评估与调试——如何量化“丝滑”感?

优化完成后,如何判断自己的视频是否真正达到了“丝滑”的标准?除了肉眼观察,还可以借助以下几个量化指标:

1.肉眼逐帧检查法

在视频编辑软件中逐帧播放视频,重点关注人物轮廓边缘、高光反射区域、背景与主体的交界处,如果这些区域在相邻帧之间没有明显变化,说明时序一致性较好。

2.数据评估法

跳帧评估:统计帧丢失率、帧间隔方差,目标帧丢失率<5%,方差趋近于0;可使用OpenCV工具计算。

时序一致性评估:重点关注光流一致性误差(越低越好)、色彩直方图距离(趋近于0最佳)、CLIP-score(语义一致性,≥0.8为优秀);可使用CLIP模型计算语义一致性得分,验证帧间关联的合理性。

五、AI视频实操指南

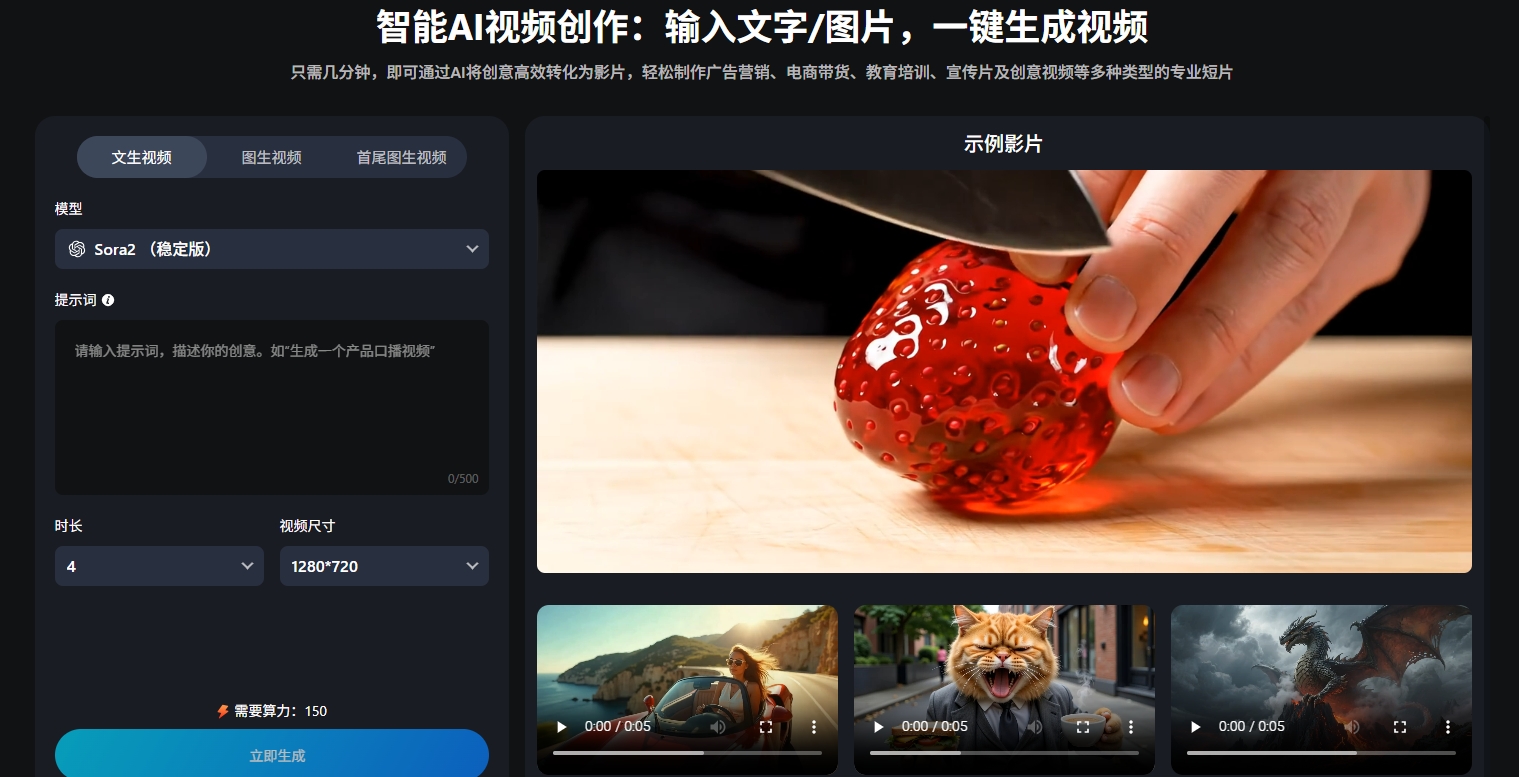

理论讲完了,我们来看一款实际能帮助解决跳帧问题的工具——移乐AI视频。这是一款AI视频生成在线工具,无需安装,打开网页即可使用。工具接入了sora 2、veo、Alibaba Wan 2.5、keling等国内外模型,生成视频的连贯性好、人物/场景一致性高、基本不跳帧,更重要是操作门槛低,不需要掌握复杂的AI参数知识,也能完成专业级的视频生成,新手、专业制作者、团队都适用。使用方法如下:

1.打开移乐AI视频官网,完成注册登录,进入“AI视频”,选择对应模式(文生视频/图生视频/首尾图生视频),选择你想要的模型,如sora2稳定版。

2.输入提示词,提示词尽量要精准,比如“生成一段15秒的短视频,人物走路,无跳帧,时序连贯,光影自然,背景固定”,选择视频比例和时长,点击“立即生成”。

3.生成完成后,预览无误的话,下载视频即可。

六、总结

AI视频跳帧和时序一致性差,并非无法解决的难题,核心是“找准根源、用对技巧、选对工具”。本文提供了解决AI视频跳帧问题办法和时序一致性优化技巧,并介绍了如何使用移乐AI视频工具生成视频的实操方法,让新手也能快速上手,专业从业者也能应对复杂场景。