AI视频生成怎么控制视频元素一致性?从原理到实操的系统指南

如果你尝试过用AI生成多镜头视频,可能遇到过这样的问题:角色的面部微妙地变形、服装在不同镜头之间变化、光照像新场景一样重置。遇到这些情况,AI视频生成怎么控制视频元素一致性?在这篇文章中,我们会分析影响一致性的关键因素,并提供一些具体的操作技巧,帮助你在AI视频生成中有效地控制元素的一致性。

一、关于视频元素的一致性

视频并非单帧图像的简单堆叠,而是时间维度上的连续叙事。元素一致性,指的是在视频序列中,特定对象的属性特征在时间和空间上保持稳定的能力。

1、元素一致性的定义与分类

具体而言,视频元素可以分为以下几类:

角色/人物形象一致性:指视频中人物的外貌特征(如面部特征、衣着、发型、肤色等)在不同镜头和帧之间保持一致。例如,AI生成的一个角色如果在不同场景或镜头中外貌不一致,观众会感到不真实,从而影响整体观看体验。

场景和背景一致性:涉及场景中的建筑物、自然景观、道具等元素的连续性。例如,如果一个场景中的背景在转场后突然改变,会导致视频的流畅性受到影响。

风格和色彩一致性:风格一致性指视频的整体视觉风格(如卡通风格、现实风格等)在生成过程中保持稳定,色彩一致性则指视频中的色调和配色在各帧之间的一致性。

动作和表情一致性:视频中角色的动作(如走路、跑步、跳跃等)以及面部表情在不同镜头中的一致性。如果一个角色在多个镜头中做出不一致的动作或表情,观众会感到不自然。

2、不一致性可能带来的问题

视频元素的不一致性会导致多个负面影响:

影响观感:视频中的不一致性会导致观众产生混乱,降低观看的沉浸感。

降低视频专业度:不一致的元素往往会让视频看起来不精细,进而影响整体的专业性和品质。

增加后期修正成本:如果在生成过程中元素一致性未得到良好的控制,那么在后期修正时,需要花费大量时间和资源来调整这些不一致的部分。

二、影响视频元素一致性的关键因素

要解决问题,必须先理解问题的根源。AI视频的“不一致”并非纯粹的故障,而是其生成机制的副作用。

1、AI模型的训练数据及其限制

现有的视频生成模型多基于扩散模型或Transformer架构。模型在学习海量视频数据时,学习的是概率分布。当模型生成视频时,它实际上是在不断“预测”下一帧的样子。如果训练数据中缺乏特定视角或动作的样本,或者样本本身存在巨大差异,模型就会陷入混乱的局面,这将导致它在生成过程中随机选择不同的特征组合,从而造成形象跳变。

2、提示词(Prompt)设计的重要性

提示词是创作者与模型沟通的唯一通道。模糊、多义或自相矛盾的提示词,会直接导致模型理解偏差。例如,仅输入“一个男人在跑步”,模型可能会在不同帧中随机生成不同肤色、不同穿着的男人。

3、多模态输入的协调性

AI视频生成模型通常会接受多种输入,如文本、图像等。这些输入之间的协调性对视频的一致性至关重要。若输入信息不一致或不明确,AI模型可能会生成相互冲突的元素,导致一致性破裂。

三、视频元素一致性控制技巧

掌握了理论成因,我们便可对症下药,通过策略性的手段接管AI的控制权。

1)Prompt设计

明确角色、动作、场景描述:在输入Prompt时,要详细描述角色的外貌、衣着、动作及场景的细节。越具体的描述越能帮助AI模型生成一致性强的元素。

使用属性关键词保持统一风格:例如,在Prompt中明确指出“卡通风格”、“现代城市风格”等属性,确保模型在生成过程中不会偏离预期的风格。

如果想要制作一个高质量的视频,提示词中通常需要含有这些公式:

[镜头语言] + [主体描述] + [动作/状态] + [光影氛围] + [画质要求]

2)分段生成 vs 整体生成

对于长视频,试图一次性生成往往会导致后半段质量崩坏。

分段生成策略:将长视频拆解为3-5秒的短片段。在每个片段生成时,严格控制上下文关联。虽然分段生成增加了拼接的工作量,但能极大提高单片段内的一致性。

衔接技巧:在分段时,利用上一段视频的尾帧作为下一段视频的参考图或起始帧,通过“接力”的方式维持场景和角色的连贯。

3)首尾图控制法

仅仅“文生视频”难以控制一致性,但首尾图生成模式则可以控制元素一致性。通过锁定第一帧(提供身份锚点)和最后一帧(锁定结束状态),通过提示词让AI填充中间过程。移乐AI视频生成工具已支持这一功能:用户上传第一帧和最后一帧图像,模型根据文本提示生成中间过渡。

4)AI视频模型选择

不同的AI模型对于视频元素一致性的控制能力不同。在目前市场上,推荐选择以下模型:

Sora2:一个能够有效处理视频生成中元素一致性的模型,适用于需要高质量视觉输出的项目。

Veo3.1:在处理复杂场景和动态动作时具有较好的稳定性,能够确保角色和背景在多场景下的一致性。

Seedance:针对多模态输入的协调性较为强大,适合需要图像、音频等多种输入的综合视频生成项目。

四、实操案例:移乐AI视频生成工具

移乐AI视频生成工具是一个聚合型在线平台,在它的AI视频生成工具中,它集成了多种主流的视频模型,如上文提到的Sora2、Veo 3.1、Seedance等,并且支持文生视频、图生视频、首尾图生视频三种创作模式,用户可根据情况选择适合的创作模式及视频模型。

下面,我们就以这款工具,试试如何用它生成一个元素一致的宇航员视频:

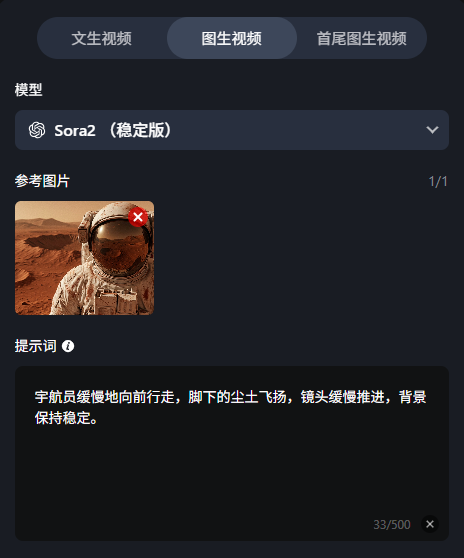

第1步: 打开移乐AI在线网站,在功能导航栏找到AI视频生成工具,选择图生视频或首尾图生视频模式,然后再选择Sora2模型。

第2步:准备并上传首帧图片

方式A(本地上传): 如果你在PS或MJ里已经做好了完美的宇航员图片,直接上传导入。

方式B(移乐内置生成): 点击“AI生图”工具,输入提示词:

“一位身穿精细白色宇航服的宇航员,特写镜头,背景是红色的火星地表,远处的陨石坑清晰可见,电影级光效,4k画质,高细节。”

筛选图片:从生成的结果中选择一张构图最稳、人物细节最清晰的图片作为“首帧素材”。

第3步:填写视频提示词

在视频生成输入框中,描述你希望发生的动作,注意要包含主体描述以加强权重。

提示词示例:“宇航员缓慢地向前行走,脚下的尘土飞扬,镜头缓慢推进,背景保持稳定。”

注意:提示词要尽量具体,但不要添加与首帧冲突的描述(如首帧是白天,提示词不要写黑夜)

第4步:点击生成并等待

点击“立即生成”按钮,等待1-3分钟(根据视频复杂度)。生成完成后先预览效果,如果满意就直接点击“下载”保存,如果不满意可以修改提示词或参数重新生成。

五、小结

AI视频生成怎么控制视频元素一致性?通过本文分享的方法技巧,我们通常可以控制好AI视频生成时里面元素一致。最后,希望本文提供的方法技巧对你是有帮助的。