2026年有哪些好用的AI生图模型?AI生图模型术语解读

回溯Sora发展历程,2024年2月其以电影级视频生成能力惊艳全球,2025年9月上线5天下载量破100万。但随后因日均运行成本达1500万美元、年耗资约54亿美元,而年收入仅140万美元,且用户留存率极低(30天留存率1%,60天留存率归零),最终关停,转而聚焦机器人等核心业务。 Sora的关停并非AI生成技术的倒退,而是其自身商业化路径不畅、算力消耗过高导致的个体选择。

相较于视频生成,AI生图技术更成熟、算力消耗更合理、应用场景更广泛,市面上有大量优质AI生图模型,能满足不同创作者需求。但问题也来了,市面上AI生图模型众多,diffusion模型、GANs模型、商用模型、开源模型有何区别?不同场景选哪种模型?专业术语难懂,易踩坑,零基础使用者面对众多模型更是无从下手。

本文将围绕AI生图模型展开,为大家全面解读AI生图模型术语,客观介绍各类好用的AI生图模型,帮助大家快速读懂AI生图模型,精准选型,轻松开启AI生图创作之旅。

一、AI生图模型是什么?

如果把AI生图模型比作一个画家,那么它不是一个在美术学院受过系统训练的人类画家,而是一个“看”过数十亿张图片之后、学会了图像与文字之间对应关系的神经网络。

从技术层面讲,当前主流的AI生图模型大多基于扩散模型架构。它的工作方式可以粗略理解为:系统先随机生成一张充满噪点的图像,然后根据你输入的文字描述,一步步地“去噪”,在每一步中调整像素,使得最终画面越来越符合文字描述的内容。这个过程之所以有效,是因为模型在训练阶段就已经学习过“噪点图→清晰图”的对应关系,学会了如何从一片混沌中还原出有意义的视觉信息。

这里有一个容易被忽略但很关键的点:AI生图模型不是“拼接素材”,而是“重构视觉概念”。 它不会从训练数据中剪切现成的图片碎片来拼凑结果,而是学习到了“猫咪”“黄昏”“赛博朋克”这些概念在像素空间中的统计分布特征,然后从噪声中重新“画”出符合这些特征的图像。理解这一点,有助于你判断为什么某些提示词组合下模型表现不佳——不是因为素材库不够全,而是模型在训练中没能将这些概念之间的关联关系学到足够扎实。

这也是为什么不同的AI生图模型即使在同一条提示词下,产出的图像风格也会截然不同。每个模型使用的训练数据、网络结构、文本编码器都有差异,导致它们对同一个概念的“理解”存在微妙差别。

二、AI生图模型分类

“AI生图模型”这个词乍一听像是一个单一的品类,但实际上它涵盖了几种差异巨大的模型类型,其中技术架构是AI生图模型的“底层逻辑”,直接决定图像生成的质量、速度和细节,目前主流分为三类:

(1)扩散模型(Diffusion Model)

目前最主流、最成熟的技术架构,也是市面上绝大多数优质AI生图模型采用的架构。核心逻辑是“从噪声到清晰图像”——先生成一张随机噪声图,再通过不断去除噪声,逐步生成清晰、连贯的图像,优势是生成图像细节细腻、色彩自然、逻辑连贯,能精准还原提示词描述,且不易出现“畸形”“模糊”等问题。

代表模型:移乐AI整合的Bytedance Seedream系列(V4.5、V4、V5.0 Lite)、Qwen Image 2.0 Pro、Hunyuan Image 3.0 Instruct,以及国外的Midjourney 7.0、Stable Diffusion。其中,移乐AI的Seedream系列经过中文语境与亚洲审美优化,生成的图像更贴合国内创作者的需求;Midjourney 7.0则在艺术表现力上表现突出,近期更新后人物细节、材质光影更真实,还新增了草稿模式,降低试错成本。

(2)生成对抗网络(GANs)

早期的AI生图技术架构,核心逻辑是“两个网络对抗学习”——生成器负责生成图像,判别器负责判断图像是否真实,两者不断对抗、优化,最终生成符合要求的图像。优势是生成速度快,适合快速生成简单图像;劣势是细节粗糙、逻辑连贯性差,容易出现人物五官畸形、场景混乱等问题,目前已逐渐被扩散模型替代,仅用于部分简单场景。

代表模型:StyleGAN(主要用于人脸生成)、DCGAN,这类模型目前应用较少,仅适合轻度、简单的图像生成需求,不适合商用或专业创作。

(3)Transformer-based模型

近年来新兴的技术架构,核心是将语言模型的“注意力机制”应用到图像生成中,能更好地理解提示词的逻辑关系,尤其是长提示词的执行能力更强,适合复杂场景、多元素的图像生成。

代表模型:移乐AI整合的Hunyuan Image 3.0 Instruct、国外的GPT-Image,其中Hunyuan Image 3.0 Instruct作为全能型编辑与融合模型,还能实现局部修改、视角切换、风格转换等复杂操作,拓展创意边界。

三、如何选择合适的ai生图模型?

选型的核心原则是“不选贵的、不选新的,只选适合自己的”,大家可以先锚定创作场景,再匹配模型长板,最后选交付方式。以下拆解三个典型场景:

场景一:快速出图,追求效率和多样性

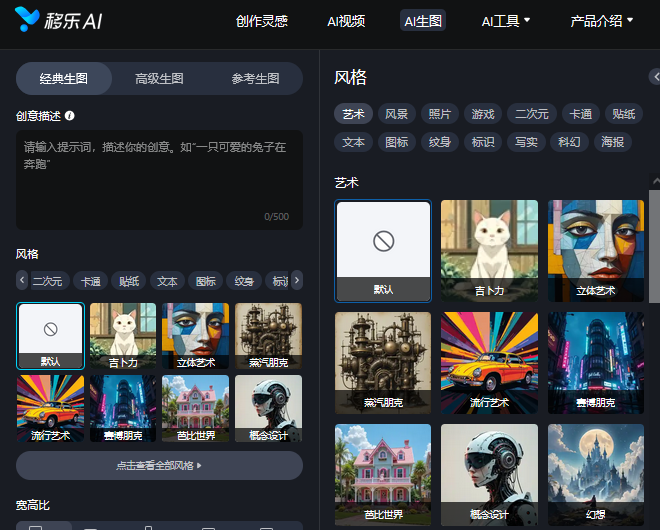

比如社交媒体配图、灵感草稿、日常创意尝试。这类场景的核心需求是速度快、风格选择多、不需要精细的参数调节。对应到工具选择上,移乐AI的“经典生图”模块就是为这个场景设计的——自研模型优化了推理速度,87种风格化模板覆盖14个风格大类,通过点选即可产出风格鲜明的作品,不需要在提示词工程上反复试错。

场景二:商业级输出,对画质和文字准确性有要求

比如电商主图、宣传海报、信息图表。这类场景需要原生高分辨率、准确的文字渲染能力,以及对亚洲审美风格的适配。Qwen Image 2.0 Pro的原生2K输出和文本渲染专长,以及Seedream V4.5在中文语境和亚洲人脸特征上的优化,都是为这类需求匹配的能力。移乐AI的高级生图模块集成了上述模型,并且可以在同一界面内切换——不需要分别去Midjourney出一个图、再去别的工具修文字。

场景三:品牌视觉维护,需要系列作品风格统一

比如同一品牌IP的多场景海报、系列插画创作。这需要的不是单次出图质量高,而是“每次出图都像同一个系列”。参考生图功能的价值在这里凸显——上传一张风格锚定图,后续所有生成都基于这张图的色彩体系和风格参数进行约束。移乐AI的参考生图模块支持6个模型,包括适合人物一致性控制的Wan 2.7 Pro和擅长复杂编辑指令的Hunyuan Image 3.0 Instruct,创作者可以根据具体需求(是需要守住人物脸型,还是需要局部修改已生成图像)灵活切换,而不必在多个平台之间反复跳转。

单个模型的能力是有边界的,而实际创作的需求是跨边界的。移乐AI的模型聚合定位——集成了来自字节跳动、阿里巴巴、快手、深度求索、智谱AI、腾讯等团队的超过20个模型——本质上是在降低用户“选错了就得换平台”的摩擦成本。选型压力从“选一个对的模型”变成了“在一个平台上找到当前任务最合适的模型”。

四、AI生图模型术语误区

AI生图领域充斥着技术名词:扩散模型、DiT、LoRA、Checkpoint、CFG、采样器……很多人误以为必须把这些术语全部学透才能开始创作。这其实是一个很大的误区。

术语不是入门门槛,而是调试工具。就像你不需要懂内燃机原理就能开车,但在车辆出现异常时,懂一些机械知识能帮你更快定位问题。AI生图术语扮演的是类似的角色——正常出图时你几乎不需要碰它们,但当你对产出不满意、想要精确控制某个变量时,这些术语的含义就变得有价值了。

1.扩散模型

当前主流AI生图模型的底层架构。你不需要理解它的数学推导,只需要记住:它决定了模型从“噪声”到“图像”的生成路径。不同模型即使采用类似的扩散架构,训练数据和训练策略的差异也会导致产出风格迥异——这也是为什么“同样是扩散模型,Midjourney和Stable Diffusion画同一句提示词结果完全不同”的原因。

2.LoRA

一种轻量化的模型微调方式,可以理解为给基础模型“打补丁”,让它在特定风格、特定角色或特定构图上表现更好。社区中大量LoRA模型是开源生态的产物,闭源平台通常不开放LoRA接入。对于不使用本地部署的用户来说,平台是否内置了足够丰富的风格选项,比是否支持LoRA更重要。

3.采样器

控制扩散模型去噪过程的具体算法。不同采样器影响出图速度、画面细节的收敛程度,以及某些风格下的表现。对于大多数日常使用场景,默认采样器已经足够好,只有在特定需求(比如追求某种复古质感或极高细节密度)时才需要手动调整。

4.提示词引导强度

控制模型对文本描述的遵从程度。强度过低,模型自由发挥空间大但可能偏离你的描述;强度过高,画面可能显得生硬、缺乏自然感。这是一个需要根据具体模型和具体需求来调的参数,没有通用最佳值。

这些术语的共性在于:它们都是“控制变量”,而不是“必填信息”。 你不需要在每一次生成前都去调整它们。合理的策略是:先用默认参数跑出结果,基于结果去反推哪个变量可能出了问题,再有针对性地调整。

五、常见问答

Q:AI生图模型是越新越好吗?

A:不一定。新模型通常在特定能力上有所突破(如更好的文字渲染、更准确的亚洲人脸),但老模型在社区积累、风格生态和稳定性上往往更成熟。选择模型应基于任务需求而非发布时间。比如需要写实人像时,一个经过充分验证的Seedream V4.5可能比某个刚刚发布但未经大规模实测的新模型更可靠。

Q:为什么同一个提示词在不同AI生图模型里出图差别这么大?

A:因为不同模型的训练数据分布、文本编码器、以及扩散过程的参数化方式都不同。它们对“同样的文字”所形成的视觉理解并不一致。这恰恰说明,提示词不是一套“万能指令”,而是需要和具体模型配合使用——换模型时,往往也需要微调提示词策略。

Q:不懂技术术语,就不能用好AI生图模型吗?

A:完全不是。正如前文所述,术语是调试工具而非准入门槛。目前以移乐AI为代表的一站式平台已经通过预设模板、参数自动适配和中文优化等手段,将术语使用频率降到了最低。你可以从“经典生图”的点选式创作开始,在需要更精细控制时再逐步了解相关术语,学习路径完全由你的需求驱动。

Q:聚合平台和单一模型工具相比,到底好在哪?

A:单一模型工具的优势在于模型与平台的深度绑定调优,出图风格稳定。但一旦你的需求超出了该模型的能力边界(比如你需要文字渲染但你的工具不擅长这个),你就必须切换到另一个平台。聚合平台的价值在于降低了这种“切换成本”——你可以在一个统一的界面和工作流中跨模型创作,比如先用Seedream生成主视觉图,再用Hunyuan Image 3.0 Instruct对局部进行编辑调整,整个流程在一个平台内闭环完成。

六、总结

理解模型分类、锚定真实场景、不被术语吓退,这三点构成了AI生图模型选型的基本框架。剩下的工作,就是实际去用、去比较、去建立自己的手感。再详尽的评测和对比,都不如你亲自上传一张图、输入一行提示词、看到生成结果那一刻的直觉来得准确。

现在,就打开移乐AI,输入你的第一个创意指令,亲手生成一张属于自己的AI图片,体验智能创作的魅力,解锁更多创作可能。