如何用照片生成视频?三步搞定动态大片(保姆级教程)

刷短视频时,总能刷到令人心动的“老照片复活”视频——泛黄的旧照片里,亲人的笑容缓缓舒展,发丝轻轻飘动,仿佛时光真的倒流;手机壁纸不再是静态画面,山水间云雾流转、花瓣缓缓飘落,氛围感拉满;就连《流浪地球3》概念片,也用图生视频技术将静态场景动态化,让科幻世界更具沉浸感。

这一切,都离不开图生视频技术的崛起。我们每个人的相册里,都藏着无数珍贵的照片:家人的团聚瞬间、旅行中的绝美风景、精心设计的产品图,这些静态画面承载着回忆与创意,却始终缺少动态的生命力。

过去,让一张照片变成视频意味着你需要学习剪辑软件、掌握关键帧动画、甚至亲自拍摄补足素材。现在,你只需要上传一张照片,写一段描述,AI就能为你生成一段动态影像。

但“如何用照片生成视频”才能得到真正惊艳的效果,而不是一段画面扭曲、运动诡异的半成品?这背后有一套值得深入理解的方法论。本文将从技术原理、实战流程到进阶技巧,为你拆解整个过程,让你无需专业基础,也能三步搞定动态大片。

理解图生视频:AI到底在“猜”什么?

要真正用好图生视频,首先需要理解它和传统视频制作之间的本质区别。

传统视频制作是“捕捉”——用相机记录镜头前真实发生的运动。而AI图生视频是“推理”——从一张静止的图像出发,去预测画面中各个元素“应该怎样运动”。

这个过程涉及三个核心环节:

1.图像理解阶段

AI首先要识别照片中有哪些物体、它们的空间位置关系是怎样的、不同区域的材质属性是什么。一片水面和一块岩石,其运动方式截然不同。模型会通过视觉编码器将图像压缩为潜空间特征,并从中提取语义信息——哪些是前景、哪些是背景、画面的深度层次如何分布。

2.运动预测阶段

系统基于对画面内容的理解,结合扩散模型(Diffusion Model)的生成能力,预测每个像素在时间维度上的变化轨迹。这一步的核心挑战在于“物理合理性”:水面应该怎么波动、云应该往哪个方向飘、被风吹动的旗帜褶皱如何变化。模型并非真正“懂得”物理,而是在训练过程中从海量视频数据里学到了运动模式的统计规律。

3.时序合成阶段

确保生成的每一帧之间在光影、色彩、物体形态上保持连贯。这也是为什么早期图生视频作品常常出现“闪烁感”——模型在帧与帧之间的一致性约束不够强,导致相邻帧的纹理细节出现跳变。当前主流的解决方案是在潜空间层面引入时序注意力机制,让模型在生成每一帧时都能参考前后帧的信息。

理解这套机制之后,你就能明白一个实际的限制:AI在基于物理规律的运动(流水、烟雾、云朵、火焰、镜头推拉)上表现出色,但在需要精确意图的人物复杂动作(转身、挥手、跳舞)上仍然不够稳定。

这不是技术缺陷,而是信息不足——单张照片里不包含“这个人接下来要做什么”的确定性答案。处理这类需求时,更合理的方式是使用“首尾图生视频”功能,上传开始和结束两个关键帧,让AI去补全中间过渡,而不是指望它凭空推理。

选图与构思:好照片是一切的起点

很多人把图生视频的成败押在提示词和模型上,但其实照片本身就是最重要的变量。同样的提示词,用在不同照片上,效果可能天差地别。

什么样的照片更“有潜力”?

1.高分辨率是底线

模型需要足够的像素信息来推理空间关系。一张短边不足512像素的低清图片,AI很难从中提取准确的深度信息和材质纹理,生成的视频往往会出现大面积扭曲和闪烁。

2.主体清晰、背景干净

如果原照片主体已经模糊,AI就需要同时“脑补”物体的外观和它的运动,出错的概率会成倍增加。

3.构图有空间感

有明确前景、中景、后景的照片,比一张扁平的大头照更容易让AI推断深度关系并生成自然的视差运动效果。

4.光线方向明确

有明显光源和阴影关系的照片,AI在生成动态光影时更有依据;光线完全均匀的平光照片,动态化后容易显“假”。

在脑海中先“预览”运动

上传照片之前,花几秒钟想清楚一个问题:你希望这张照片怎么动起来?运动可以分为两大类,创作时最好明确主导方向:

1.镜头运动——画面内容不变,视角变化。

比如相机缓缓推近人物面部、镜头横向掠过风景、无人机环绕建筑飞行。这类运动最容易实现,效果也最稳定,因为不需要AI去改变画面中的物体形态,只需推理不同视角下的画面。

2.内容运动——照片里的事物自身发生改变。

比如河流开始流动、人物发丝被风吹起、霓虹灯逐一亮起、云层翻涌滚动。这类运动需要AI对特定物体的运动规律有更精准的把握。

一个实用的经验是:先从镜头运动入手,产出稳定的结果后,再逐步加入内容运动的要求。这样迭代能帮你快速摸清模型对这张照片的理解程度。

移乐AI实战全流程:从上传到出片

选好了照片,明确了运动方向,接下来进入实际操作环节。以移乐AI的图生视频功能为例,它的核心优势在于将模型多样性和一站式工作流结合在一起。

移乐AI是一站式智能创作平台,深度整合了从图像生成、编辑到视频创作的完整AI工作流,提供包括AI生图、AI生视频、图生视频、图片变清晰、老照片修复等18项核心功能,覆盖个人创作、内容营销、电商视觉、专业设计等多场景需求。

其图生视频模块聚合了21个可用模型,其中包含3个为“图生视频”任务专项优化的版本(如Kwaivgi Kling V1.6 I2V Pro及Minimax Hailuo 2.3 Fast系列)。I2V专项模型意味着这些模型在训练阶段接受了更多图像-视频配对数据的训练,对图像内容的理解和动态推理准确度更高。

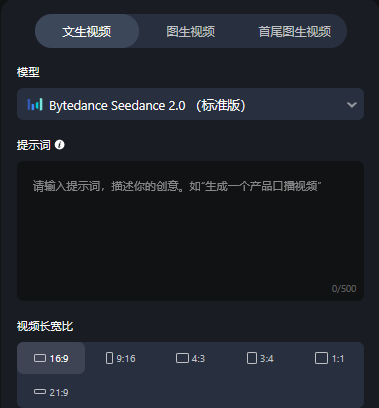

第一步:上传与基础设置

打开移乐AI平台,找到“图生视频”功能模块,点击上传提前准备好的照片(支持JPG、PNG等常见格式,单张照片大小控制在10MB以内即可)。上传完成后,根据创作需求设置视频比例(适配抖音9:16、朋友圈1:1、公众号16:9等主流平台)和时长(移乐AI支持生成不同时长的视频,可根据需求选择4秒、8秒等版本)。

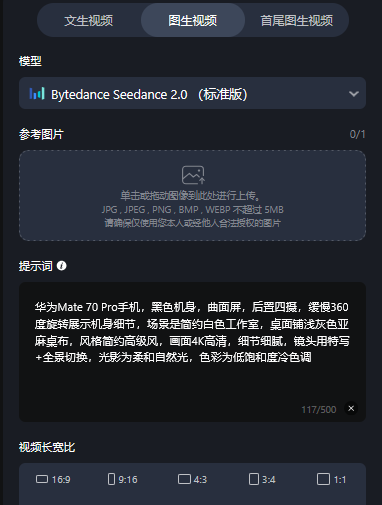

第二步:撰写提示词

提示词是决定视频最终呈现效果的另一个关键杠杆。在图生视频中,提示词不需要描述画面内容(因为AI已经看到了照片),而是专注于描述运动方式和氛围质感。

一个有效的提示词通常包含两个层次:

运动描述层——告诉AI画面中要发生什么运动。比如:“镜头缓慢向前推进,主体人物保持静止,背景逐渐模糊”、“湖面泛起轻微的涟漪,倒影轻轻晃动”、“云朵从左到右缓慢飘移,光线随时间变化”。

运动描述的颗粒度直接影响产出的可控性。“湖面波动”是粗糙指令,“湖面泛起同心圆波纹,从中心向四周扩散”则提供了更具体的运动模式,AI能更准确地执行。

风格定调层——定义视频的整体氛围和质感。比如:“电影感、柔和的自然光、浅景深”、“梦幻朦胧、柔焦效果、胶片颗粒质感”、“纪录片风格、手持摄影机轻微的呼吸感”。

这里有一个容易被忽略的技巧:负向提示词。明确告诉AI你不想要什么,有时比告诉它你想要什么更高效。常见的负向提示词包括:“画面闪烁、扭曲变形、不自然的抖动、鬼影、运动模糊过度、人物变形”。

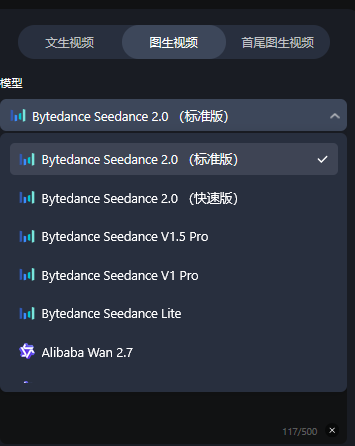

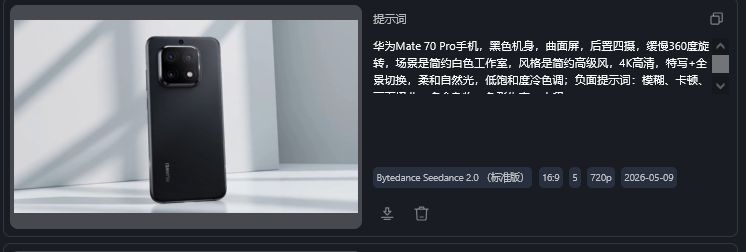

第三步:选择适合的模型

移乐AI图生视频的突出优势在于模型选择的丰富度。它不是一个模型应对所有场景,而是提供了21个可选模型,覆盖不同的风格偏好和场景侧重。具体怎么选,取决于你的创作目标:

①追求极速出图与流畅动态

Bytedance Seedance 2.0快速版和V5.0 Lite系列在速度和质量间取得了平衡,适合需要快速迭代试错的阶段。快速版尤其适合社交媒体内容的批量产出,在保证画质的前提下将等待时间压缩到最低。

②对画质和物理准确度要求高

Seedance V1.5 Pro是更偏向电影级专业的选项,在光影变化和时序连贯性方面表现更细腻。适合用于广告提案、品牌视觉素材等对品质有严格要求的场景。

③自然风景与空镜

Seedance系列和Wan 2.7在自然场景的动态推理上表现稳健,对水流、云、植被等元素的运动规律把握较好。其中Wan 2.7还支持真人照片驱动,如果你的照片以人物为主体,该模型的运动推理更符合人体运动规律。

④短视频节奏与创意表达

Vidu Q3针对短视频内容的节奏感和视觉冲击力做了优化,适合制作快节奏卡点、视觉创意类内容。

⑤图像转视频专项优化

Kwaivgi Kling V1.6 I2V Pro和Minimax Hailuo 2.3 Fast系列是专门为图生视频任务训练的版本(而非文生视频模型的图生模式适配),在理解图片内容和生成合理动态方面有更深度的训练,出图保真度更高。

之所以要强调模型选择,是因为“图生视频”不是一个单一任务。你让一张风景照动起来,和让一张人物肖像动起来,底层需要的推理能力是不同的。单一模型很难在所有场景都做到最佳。

移乐AI的“模型聚合器”定位——持续集成来自字节跳动、阿里巴巴、快手、深度求索、智谱AI、腾讯等团队的模型——意味着你可以根据当前任务灵活切换引擎,而不需要在不同平台间反复跳转和重复付费。

点击生成后,通常等待数十秒到几分钟(取决于模型和时长设置)就能看到结果。但第一次生成就达到理想效果的概率并不高——这不是工具的问题,而是创作本身的常态。

评估生成结果时,重点关注三个维度:

- 运动是否自然:有没有明显违背物理规律的扭曲?

- 主体是否稳定:核心人物或物体的形态有没有出现明显变形?

- 画面是否连贯:是否存在严重的闪烁或跳帧?

基于评估结果进行调整:运动不够明显就加强提示词中的运动描述;主体变形就降低运动幅度要求,或增加负向提示词中的变形约束;画面闪烁就尝试换用更高画质的模型,或适当缩短生成时长。

进阶技巧:让动态照片具备电影感

当你掌握了基础流程后,以下技巧能帮你将产出提升到新的层次。

1.镜头语言的精确使用

在提示词中使用专业镜头术语,AI对这些术语的理解往往比对自由描述更准确。例如:“缓慢的推轨镜头,焦点从前景移到背景”、“希区柯克式变焦,背景压缩感增强”、“浅景深的微距镜头,只有主体清晰”。

2.局部运动的精确控制

与其让整张照片都动起来,不如尝试“时空冻结”式的处理——让画面中大部分区域保持静止,只有特定元素产生运动。比如一张城市夜景照片里,只有霓虹灯在闪烁,街道和建筑完全静止。

这种动静对比反而比全画面运动更有视觉张力和真实感。

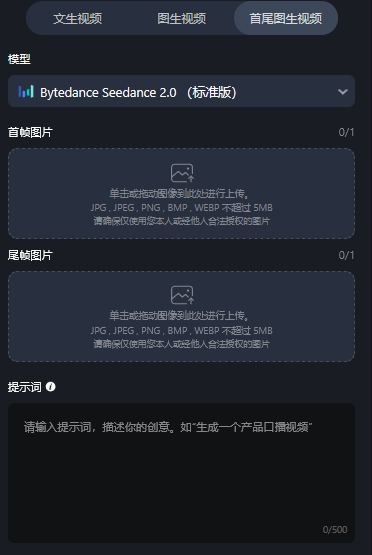

3.结合移乐AI的“首尾图生视频”功能

如果你有两张不同姿态或构图的照片(比如同一个人物、同样的场景,但表情或动作有变化),可以分别设为起始帧和结束帧,让AI生成中间平滑过渡。这个功能在移乐AI中支持10个模型选择(包括Bytedance Seedance系列和Alibaba Wan 2.7等),特别适合制作有明确叙事起点和终点的动态转场,比如从品牌Logo演化为产品实拍、从设计线稿变成3D渲染效果。

所用模型在时序连贯性与叙事补间方面表现突出,能够自动推理出符合物理逻辑的中间状态。

4.照片“预处理”提升动态潜力

上传前用移乐AI的“图片变清晰”功能提升老照片或低分辨率图片的细节密度,可以有效降低生成视频时的闪烁和模糊问题。“背景模糊”功能可以在生成视频前就为照片增加自然的景深层次,AI理解照片的空间关系会更加准确。

5.风格融合的创意突破

不一定非要让照片以写实风格动起来。你可以尝试在提示词中加入风格化指令——比如把一张写实人像照片变成“梵高油画风格的动态肖像”,或者将一张街拍变成“赛博朋克风格的动态场景”。

移乐AI的图生视频功能与其AI生图模块无缝衔接,你可以先在参考生图模块中创建风格化变体,再将其导入图生视频进行动态化,实现从风格迁移到动态生成的全流程一站式完成。这种“风格锚定→动态生成”的闭环工作流,是单一功能工具难以提供的效率优势。

常见问题与解决思路

Q:生成的视频为什么会出现画面闪烁或局部扭曲?

A:闪烁和扭曲是图生视频最常见的两类问题。闪烁通常源于模型在帧间一致性上的不足——画面在相邻帧之间出现了微小的纹理跳变。

解决方案包括:使用更高画质的模型、适当缩短生成时长、在负向提示词中加入“闪烁、跳帧、画面不稳定”。局部扭曲则往往是因为原图该区域信息不足(如低分辨率、大面积纯色),AI在推测运动时“猜错”了。换用分辨率更高的原图、或选择对物理规律理解更好的模型(如Seedance V1.5 Pro)通常能缓解。

Q:能让照片里的人物做出特定动作吗?

A:这是目前图生视频技术的主要局限。单张照片提供的信息不足以让AI精准判断人物的骨骼结构和运动意图。

如果确实需要人物做特定动作,建议尝试移乐AI的“首尾图生视频”——上传两张人物不同姿态的照片作为首尾帧,AI补全中间过渡,比单图驱动可靠得多。另一个思路是用“镜头运动”替代“人物动作”,推近、环绕、慢摇同样能制造出富有叙事感的动态画面,且效果稳定。

Q:移乐AI的图生视频功能如何开始体验?

A:新用户注册即得50算力,每月登录可再领50算力(有效期30天)。如果需要更高频次使用,算力充值方案(如99.9元获得3500算力,永久有效)和会员订阅方案(如32元/月标准会员,含1200算力及视频无水印、1080P高清下载等权益)都提供了灵活的选项。考虑到平台聚合了21个图生视频模型,单个平台的模型切换成本远低于在多个工具间分别订阅和充值。

总结

图生视频技术的价值,不仅在于让个人珍贵的照片“活”起来,让回忆更具生命力,更在于为各行各业提供了全新的内容生产力工具:电商卖家可快速将产品图转化为宣传视频,降低营销成本;自媒体创作者可轻松制作动态配图,提升内容吸引力;文旅行业可将风景照转化为动态宣传片,展示地域特色;教育行业可将静态知识点转化为动态视频,提升教学趣味性。

不要再让精彩的照片沉睡在相册里,不要再因传统视频制作的高门槛而放弃创意。立即打开移乐AI,上传你的第一张照片,用最简单的提示词,亲眼见证静态记忆转化为动态故事的魔法时刻,用AI赋能创意,打造属于你的动态大片。