AI视频生成神器怎么选?从原理到实战,一篇看懂所有门道

2026年,AI视频创作彻底迎来爆发期——第十三届中国网络视听大会上,AI技术成为绝对核心热词,腾讯宣布将在第三季度推出全球首部全流程AI制作电影,单部时长90分钟,从剧本到特效100%由AI完成,填补了30分钟以上AI长内容的市场空白;此前清明档刷屏的AI短片《纸手机》,更是凭借AI赋能的细腻质感,斩获全网超4000万播放量,获得权威媒体点赞转发。

从自媒体博主的短视频引流、电商卖家的产品演示,到企业的品牌宣传、影视行业的短片创作,AI视频生成神器已经成为内容生产者的“必备工具”。但问题也随之而来:市面上的AI视频生成神器五花八门,海外工具、国产工具层出不穷,AI视频生成神器怎么选?AI视频生成的“魔法”到底是怎么实现的?为什么同样用AI,有人能生成电影级成片,有人却只能做出模糊、杂乱的片段?

今天这篇文章,就盘点2026年最值得入手的六大AI视频生成神器,帮助大家快速找到适合自己的AI视频神器,高效落地创意。

一、AI视频生成工具的原理

很多人觉得AI视频生成很“神奇”,输入一段文字就能变出动态画面,以为背后有什么高深莫测的技术,甚至不敢轻易尝试。其实不然,AI视频生成的核心原理,本质就是“AI模仿人类创作视频的逻辑”。

1.扩散模型,AI视频的“创作大脑”

目前所有主流AI视频生成神器,核心都离不开“扩散模型”——它就相当于AI的“大脑”,学会了人类制作视频的逻辑,能把文字描述转化为连贯的动态画面。

用生活化的比喻来说,扩散模型的工作逻辑就像“学画画+拍视频”:工程师会给AI“喂”上亿条高清视频,还有这些视频对应的文字描述,比如一段“猫咪在阳光下睡觉”的视频,会配上对应的文字。AI会反复学习这些视频,记住每一个画面的细节、动作的连贯性、光影的变化,以及文字描述和画面之间的关联——就像我们小时候学画画,先模仿别人的作品,慢慢掌握构图、上色、动态的技巧。

当你输入文字提示词时,AI就会调动自己学到的所有知识,先理解文字的含义,再拆解出画面的核心元素,然后逐帧生成画面,最后把这些画面拼接起来,加上动态效果,形成一段完整的视频。简单来说,扩散模型的核心就是“学习海量数据→理解文字需求→生成连贯画面”,这也是AI视频能快速落地的关键。

除了扩散模型,部分工具还会结合其他技术优化效果,比如Runway ML的Gen-4.5模型,就在扩散模型的基础上,强化了镜头控制和角色一致性,让生成的视频更具叙事感,但核心逻辑都是一样的,我们作为使用者,不用深究技术细节,知道“输入文字,AI就能生成视频”就足够了。

2.4步完成“文字→画面”的转化

不管是哪款AI视频生成神器,核心流程都离不开这4步:

1. 文本理解:AI先精准解读你输入的提示词,提取核心信息,比如主体(猫咪)、动作(睡觉)、场景(阳光下)、风格(治愈风),明确你想要的视频效果;

2. 画面拆解:AI把文字描述拆解成一个个独立的画面元素,比如猫咪的外形、阳光的光影、背景的细节,再规划出每一秒的画面内容;

3. 逐帧生成:AI根据拆解的元素,逐帧生成静态画面,每一张画面都贴合提示词的要求,同时保证细节连贯、光影统一;

4. 合成输出:AI把所有静态画面拼接起来,添加动态效果、过渡动画,有的工具还会自动添加背景音乐、字幕,最终生成一段完整的视频,输出给用户。

二、2026年六大AI视频生成神器推荐

2026年,AI视频生成工具迎来爆发式增长,国内外各类神器层出不穷,有的主打专业级效果,有的侧重便捷操作,有的擅长特定场景,下面就客观盘点6款最值得入手的神器。

1. 移乐AI

移乐AI作为国内一站式智能创作平台,核心优势在于“模型全、适配性强、操作简单、性价比高——平台整合了来自字节跳动(Seedream/Seedance)、阿里巴巴(Wan)、快手(Kling)、腾讯(Hunyuan)等国内外顶尖AI团队的最新模型,去重后超过20个顶尖模型,比很多海外工具的模型选择更丰富,能满足不同场景的创作需求。

在AI生视频方面,移乐AI提供三种前沿生成模式,覆盖从静态构思到动态叙事的完整创作流程,适配全场景需求:

一是文生视频,提供18个模型可选,覆盖完整的需求谱系:追求极致速度的Seedance 2.0快速版、平衡质效的标准版、电影级专业的Seedance V1.5 Pro,支持真人照片驱动的Alibaba Wan 2.7,还有专为抖音、快手等国内短视频平台优化的Vidu Q3,不管是广告、影视预告,还是社交媒体短视频、产品演示,都能轻松搞定;

二是图生视频,包含文生视频的全部18个模型,还额外增加3个专项优化模型,能让静态图片“动”起来,精准理解图片内容和空间关系,生成流畅的动态效果,是存量素材增值的最佳方式,比如把电商产品图生成动态演示视频,不用重新拍摄;

三是首尾图生视频,提供10个优质模型,用户只需上传开头和结尾两张关键帧图片,AI就能自动推理生成中间的过渡动画,擅长制作有故事性的转场效果,适合做专业级动态简报、故事短片、创意转场。

除此之外,移乐AI还打破传统创作中多个工具割裂的状态,整合了AI生图、AI生视频、图片编辑、视频编辑等18项核心功能,生成图片后可直接用于图生视频,生成视频后可直接在平台抠图、换背景、加字幕,不用在不同软件间反复导出导入,极大提升创作效率。

适用场景:个人创作(短视频、头像、创意短片)、内容营销(电商产品演示、自媒体引流)、企业宣传(品牌短片、活动预告)、专业设计(影视预告、动态简报),覆盖全场景,尤其适合中文用户和零基础新手。

2. Runway ML

Runway ML是海外AI视频生成工具的“专业级标杆”,主打影视工业级效果,2026年初上线的Gen-4.5模型,进一步强化了核心优势,在运动控制与画面一致性上处于行业领先地位。

核心优势:擅长生成电影级视频,精准镜头控制能力突出,支持推、拉、摇、移等运镜参数精细化调节,能实现导演级的画面掌控;解决了AI视频中角色忽大忽小、面容改变的痛点,多镜头切换中能保持高度连贯的叙事与角色一致性;支持生成更长、逻辑更完整的视频段落,适合复杂叙事。

不足:操作门槛较高,适合有一定专业基础的创作者;收费较贵,没有免费算力,新手体验成本高;中文语义理解一般,输入中文提示词可能出现偏差,对中文用户不够友好。

适用场景:专业影视创作、电影预告、高端广告制作,适合有专业基础、追求极致画面质感的创作者。

3. Pika Labs

Pika Labs以独特的电影美学和风格化生成著称,是创意创作者的首选工具,擅长生成具有艺术感的视频,风格多样性远超同类工具。

核心优势:风格化表现突出,支持电影 noir、赛博朋克、水墨风、日系动漫等多种艺术风格,生成的视频画面细腻、氛围感强,极具观赏性;对细节的还原度高,能精准呈现提示词中的光影、色彩和质感;操作相对简单,新手也能快速上手。

不足:模型选择较少,侧重风格化创作,在实用型场景(如电商产品演示)中的表现不如移乐AI;生成速度较慢,复杂风格的视频可能需要几分钟甚至更久;中文语义理解有待优化。

适用场景:创意短片、艺术创作、社交媒体氛围感短视频,适合追求画面美学、喜欢个性化风格的创作者。

4. Synthesia

Synthesia的核心定位是“AI数字人视频工具”,主打企业级视频解决方案,专门简化口播视频、培训视频的制作流程,不用拍摄、不用真人出镜,就能生成专业的口播视频。

核心优势:数字人生成能力强,提供多种数字人形象,支持自定义数字人五官、穿着、语气,能生成逼真的口播效果;支持多语言口播,适合企业出海宣传;操作简单,输入脚本就能生成完整的口播视频,大幅节省企业视频制作成本。

不足:功能相对单一,主要聚焦于数字人口播,创意类视频、产品演示视频的表现一般;数字人风格偏向商务风,个性化不足;收费较高,适合企业用户,个人用户性价比不高。

适用场景:企业培训视频、产品介绍口播、企业宣传口播、出海视频,适合企业用户和需要频繁制作口播视频的创作者。

5. InVideo AI

InVideo AI的核心优势是“自动化”,擅长将文章、脚本一键转化为带素材、配音、字幕的完整视频,不用手动添加任何元素,适合需要快速批量生产视频的创作者。

核心优势:自动化程度高,粘贴文章或脚本,AI就能自动匹配素材、添加AI配音和字幕,生成完整视频;支持批量生成,适合自媒体博主、企业批量生产引流视频;操作简单,零基础新手也能快速上手,生成速度快。

不足:视频质感一般,缺乏个性化,生成的视频同质化严重;素材库多为海外素材,适配国内场景的素材较少;对中文文章的适配度一般,偶尔会出现素材与内容不符的情况。

适用场景:自媒体引流视频、批量生产的科普视频、简单的企业宣传视频,适合需要快速批量出片、对画面质感要求不高的创作者。

6. Fliki

Fliki以高质量AI语音生成和简易操作为核心优势,主打“文字转视频+AI配音”,全球拥有1200万+用户,累计生成超1亿条视频,支持80+语言,适合侧重语音表现的视频创作。

核心优势:AI语音质量高,拥有2000+ lifelike AI voices,支持80+语言和方言,语音有真实情绪、节奏和重音,堪比真人配音;操作极简,粘贴脚本、博客文章或一句话提示词,AI就能自动写脚本、选素材、加配音和字幕,5分钟内就能生成可发布的视频;支持数字人功能,可生成自己的数字孪生,实现无拍摄创作。

不足:视频画面质感一般,创意性不足,主要适配简单的口播、科普视频;中文语音的适配度不如移乐AI,部分方言语音不够自然;核心功能集中在语音和自动化生成,复杂视频的表现一般。

适用场景:口播视频、科普视频、自媒体短脚本视频,适合侧重语音表现、需要快速出片的创作者。

三、提示词(Prompt)全攻略

很多人选对了AI视频神器,却还是生成不出满意的视频,核心问题就出在“提示词”上。提示词就相当于AI的“咒语”,直接决定了生成视频的质量、风格与准确性——同样一款工具,输入精准的提示词,能生成电影级成片;输入模糊的提示词,只能生成杂乱、偏离预期的片段。

1. 提示词为何是“咒语”?

AI本身没有“创意”,它所有的创作都来自于对海量数据的学习和对提示词的理解。提示词就是你给AI的“指令”,清晰、精准的指令,能让AI快速抓住你的需求,生成符合预期的视频;模糊、笼统的指令,会让AI“摸不着头脑”,只能凭自己的理解随意生成,自然达不到预期效果。

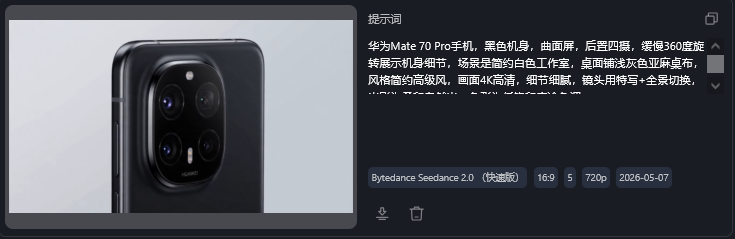

举个简单的例子:同样用移乐AI生成视频,输入“猫咪睡觉”,AI可能会生成模糊、背景杂乱的片段;而输入“橘色猫咪,眯着眼睛,趴在浅灰色沙发上,阳光从窗户洒入,风格治愈,画面4K高清,镜头用特写+慢镜头”,AI就能生成细节饱满、风格鲜明的视频——这就是提示词的重要性。

2. 优质提示词结构

大家不用费心琢磨优质提示词,记住这个核心结构,新手也能写出高质量提示词:主体 + 动作/场景 + 风格/质感 + 技术参数(镜头、光影等)。

① 主体:明确视频的核心对象,补充关键细节,让AI精准识别,比如“华为Mate 70 Pro手机,黑色机身,曲面屏,后置四摄”“身穿白色汉服的古风美女,长发及腰,眉眼温柔”;

② 动作/场景:明确主体在做什么、在什么场景下做,让视频有画面感和连贯性,比如“缓慢360度旋转,展示机身细节”“站在樱花树下,轻轻抬手拂过花瓣,背景有飘落的樱花”;

③ 风格/质感:明确视频的整体风格和画面质感,让视频更有调性,比如“简约高级风,4K高清,细节细腻”“电影级质感,胶片颗粒感,暖色调”;

④ 技术参数:补充镜头、光影、色彩等简单参数,提升视频专业度,不用太复杂,新手掌握基础参数就够了,比如“镜头用特写+全景切换,光影为柔和自然光,色彩为低饱和度冷色调”。

完整示例(适配移乐AI文生视频,Seedance 2.0模型):“华为Mate 70 Pro手机,黑色机身,曲面屏,后置四摄,缓慢360度旋转展示机身细节,场景是简约白色工作室,桌面铺浅灰色亚麻桌布,风格简约高级风,画面4K高清,细节细腻,镜头用特写+全景切换,光影为柔和自然光,色彩为低饱和度冷色调”。

3. 负面提示词:明确“不想要什么”,避开雷区

很多新手忽略了负面提示词,但它其实是提升出片质量的“关键一步”——负面提示词就是告诉AI“不要出现什么内容”,帮AI规避常见的雷区,减少返工次数,尤其适合追求细节的创作者。

常见的负面提示词的分类,新手直接参考:

① 画面质量类:模糊、卡顿、低画质、画面扭曲、色彩失真;

② 元素杂乱类:多余杂物、水印、文字杂乱、背景杂乱;

③ 人物类(若有人物):人物畸形、AI脸、五官模糊、比例失调;

④ 动态类:镜头抖动严重、动作不连贯、物理逻辑错误。

示例(搭配正面提示词):“华为Mate 70 Pro手机旋转展示,场景简约白色工作室,风格高级,4K高清;负面提示词:模糊、卡顿、多余杂物、色彩失真、水印、画面扭曲”。

提示:负面提示词不用太多,精准针对常见问题即可,比如用移乐AI生成产品视频,重点规避“多余杂物、色彩失真”;生成人物视频,重点规避“AI脸、人物畸形”,让AI更精准地聚焦核心需求。

四、总结:选对神器,让创意高效落地

回顾2026年的AI视频创作市场,AI视频生成神器已经彻底重塑了内容创作的模式——它打破了专业门槛,让普通人也能轻松制作高质量视频;缩短了创作周期,让创意从“想法”到“成片”的时间从“天”缩短到“分钟”;降低了创作成本,让个人和企业都能高效产出内容,这就是AI视频工具的颠覆性价值。

对于广大中文用户而言,移乐AI的优势不言而喻:它聚合了超过20个顶尖模型,生成能力媲美海外顶级工具;深度本土化优化,精准理解中文语义,适配国内内容平台,比海外工具更贴合我们的创作习惯;一站式无缝工作流,从生图到生视频、从创作到编辑,全程不用切换软件,大幅提升效率;友好的免费政策和高性价比,让新手能免费体验,企业用户能控制成本,真正实现“人人都能成为AI创作者”。

2026年,AI视频创作的浪潮已经来临,与其羡慕别人的高质量成片,不如从现在开始,打开移乐AI,让AI帮你把想法快速落地。