AI视频创作入门指南:从定义到应用的全方位解析

随着AI技术的不断发展,让视频创作领域迎来了重大的变革。曾经,视频制作是专业人士的领地,昂贵的设备、复杂的剪辑软件、庞大的摄制团队以及高昂的时间成本,使得很多人无法跨进视频创作领域。而AI视频技术的出现,极大地简化了这一过程,只需一段文字或几张图片即可帮助用户生成一个专业级别的视频。

为了方便广大用户对AI视频生成有一个清晰的认知,本文会为读者提供一个系统性的指南,全面解析AI视频的基本概念、核心技术、应用领域及主流工具平台等AI视频方面的相关知识。

一、什么是AI视频?

在深入技术细节之前,我们首先需要明确AI视频的本质。

1、AI视频定义

AI视频,是指利用人工智能技术,特别是深度学习和生成模型,来自动生成或辅助生成视频内容的技术。这些技术能够“理解”视频所需的元素,包括场景、人物、动作等,并基于这些元素合成视频内容。与传统的CGI(计算机生成图像)不同,AI视频生成不再依赖逐帧渲染,而是通过智能算法对语义进行理解和建模,从而创造出连贯的视频片段。

AI视频技术与传统CGI的区别主要在于:

逐帧渲染:传统CGI技术依赖手工设计和渲染每一帧图像,制作过程复杂且时间成本高。

语义理解生成:AI视频则通过理解视频的整体语义来生成画面,避免了繁琐的逐帧处理,生成速度更快,效果也更自然。

2、主流生成方式分类

目前,根据输入形式的不同,AI视频生成主要分为三类:

文生视频:这是最基础也是最考验模型能力的模式。用户仅需输入一段文字描述,模型即可从头开始生成相应的视频片段。这要求模型不仅要理解文本语义,还要具备构建合理视觉场景的能力。

图生视频:用户上传一张静态图片,AI根据图片内容或额外添加的文字指令,让画面“动”起来。例如,让一张静态的人物照片开口说话,或让风景照中的云朵流动、河水奔腾。这种方式在风格控制和画面构图上具有更高的确定性。

首尾图生视频:这是更高级的控制方式。用户提供视频的第一帧和最后一帧画面,并添加中间内容文字,AI则可以直接生成中间的过渡动作与过程。

二、AI是如何“看懂”用户需求的?

AI视频生成的效果之所以能如此逼真,背后离不开两大核心技术的支撑。了解这些原理,有助于我们更好地理解模型的特性与局限。

(1)AI核心技术

1、扩散模型:目前主流视频生成模型(如Sora、Runway等)多基于扩散模型。其原理可以类比为一个“去噪”的过程。比如,给AI提供一张满是雪花噪点的老电视画面,AI模型通过学习,能够从这团混乱的噪点中,一步步去除杂质,还原出清晰的图像。

2、Transformer架构:如果说扩散模型解决了“画面清晰度”的问题,Transformer架构则解决了“视频连贯性”的问题。Transformer是处理自然语言的利器,它具有强大的序列理解能力。在视频生成中,它让AI理解了“时间序列”——即前一帧画面与后一帧画面的逻辑关系。通过这种架构,模型能够记住视频中角色的样貌、动作的方向,保证视频前后帧的连贯性,这是解决画面闪烁、变形问题的关键所在。

(2)生成难点与突破

物理规律的模拟:让AI理解光影如何变化、重力如何影响物体、流体如何流动,一直是AI视频生成技术的难点。

长视频的一致性维持:在生成长视频时,确保视频中的人物、物体不会变形或者失去连贯性,仍是技术发展的难点。所以,如何在数分钟的视频中让同一人物不变形、不换装,是AI视频生成技术维持叙事连贯性的关键所在。

不过,虽然早期出现诸多技术上的问题,但现在这些难点正在被逐一击破。随着谷歌Veo 3和OpenAI Sora 2等顶级视频模型的发布,AI视频正式迈入了“写实时代”。

OpenAI Sora 2:在物理模拟与风格控制上实现了质的飞跃。它能够精准模拟光影反射、物体碰撞等复杂物理过程,且支持单次生成最长20秒的1080p高清视频,画面中的人物皮肤纹理、动物毛发细节栩栩如生,几乎达到了以假乱真的程度。

谷歌Veo 3/3.1:则在功能维度上更进一步。其最大的优势在于“原生音频生成”——生成的视频自带与画面完美匹配的音效,如脚步声、风声,这在业界是巨大的突破。同时,它支持生成最高4K分辨率的视频,并提供了电影级的镜头控制功能。

三、主流的AI视频工具平台一览

1、国际第一梯队工具

OpenAI Sora 2:行业标杆,强于物理模拟与风格控制,支持20秒1080p高清生成,适合制作高质量短视频内容。Sora 2 Pro更进一步,单次可生成高达25秒的视频,每帧投入更多算力,将会带来更好的纹理细节和更真实的照明。当然,这需要用户订阅ChatGPT Pro(200美元/月)使用。

谷歌Veo 3/3.1:优势在于原生音频生成和精准的镜头控制(支持4K分辨率),用户可通过“镜头语言指令”(如“推近”“摇镜头”)控制视频的运镜方式,实现专业级拍摄效果。其“素材转视频”功能允许上传多张参考图,直接指导角色、物体和风格,特别适合品牌内容和角色驱动型叙事。通过Google Flow平台使用。

Runway & Midjourney V1:作为老牌平台,Runway在创意短片制作上表现稳定,性价比高。而Midjourney V1作为图像巨头的视频试水之作,继承了其强大的美学风格,适合追求艺术感的创作者。

2、国内主流在线平台

对于国内用户而言,直接订阅国外的ChatGPT Pro或使用Google Flow往往面临支付渠道繁琐、网络访问不稳定等门槛。此时,选择一个集成度高、访问便捷的平台至关重要,要满足这些需求,国内用户可以选择移乐AI在线平台。

移乐AI是一个聚合型的AI创作平台,它汇集了包括Sora 2、谷歌Veo等国际主流视频模型,同时也整合了国内优秀的视频生成能力。对于新入门的AI视频创作者来说,移乐AI不仅解决了“工具难找、账号难注”的痛点,更提供了一站式的创作环境,让你无需在多个软件间切换,就能体验到全球最顶尖的AI视频生成技术。

四、实操指南:从0到1制作出AI视频

为了让大家更直观地了解创作过程,我们以操作便捷的移乐AI平台为例,演示如何制作一支高质量的AI视频。

步骤1:登录并选择模型

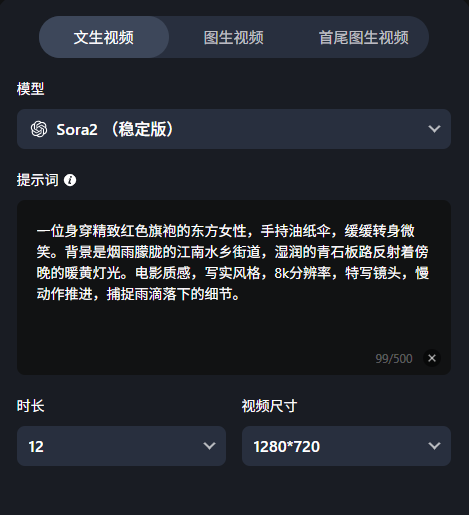

访问移乐AI官网,完成注册登录,系统自动赠送50算力值。进入“AI视频”版块,选择文生/图生/首尾图生视频,然后在模型列表中选择Sora 2或其他心仪模型。

步骤2:提示词与参数设置

AI视频生成的质量,很大程度上取决于你的提示词。所以,在提示词的撰写上我们还是需要花一些心思的。如果你不知道如何写提示词,可以遵循这个“万能公式”:

“核心主体+动作描述+环境氛围+风格参数+镜头语言”

核心主体:明确画面的主角是谁,细节越丰富越好。例如,“一位身穿红色旗袍的东方女性”。

动作描述:主体在做什么。例如,“缓缓转身,手持一把油纸伞”。

环境氛围:场景在哪里,光线如何。例如,“在烟雨朦胧的江南水乡街道,石板路湿润反光,傍晚的微光”。

风格参数:画面的艺术风格。例如,“电影质感,高对比度,写实风格”。

镜头语言:导演视角。例如,“特写镜头,背景虚化,慢动作推镜”。

完整的提示词示例:

“一位身穿精致红色旗袍的东方女性,手持油纸伞,缓缓转身微笑。背景是烟雨朦胧的江南水乡街道,湿润的青石板路反射着傍晚的暖黄灯光。电影质感,写实风格,8k分辨率,特写镜头,慢动作推进,捕捉雨滴落下的细节。”

最后,别忘记设置时长、视频尺寸等参数哦!

步骤3:点击生成并等待

设置完成之后,点击“立即生成”等待AI处理并生成视频。在此过程中,AI会根据提示词进行处理,并输出最终视频。

五、AI视频能用在哪里?

目前,随着AI视频技术不断趋于成熟,它正在渗透进各行各业的创作流程中。比如:

内容创作:

短视频、广告、宣传片制作:AI能够快速生成符合品牌调性的短视频内容,提升生产效率。

影视特效与动画制作:AI帮助特效制作更快、更高效,降低了成本。

教育与培训:

AI讲解视频、虚拟教师、交互式教学:AI视频可以作为教师的辅助工具,为学生提供更生动的学习体验。

商业与营销:

个性化广告、智能营销视频:AI能够根据用户行为生成个性化广告,提升广告转化率。

数据可视化展示:将复杂的数据通过AI生成视频形式展现,增强可理解性。

娱乐与社交:

游戏动画、虚拟偶像、社交媒体内容生成:AI不仅能够生成游戏动画,还能创造虚拟人物,推动娱乐行业的发展。

六、全文小结

总的来说,,AI视频已经渗透在许多行业之中,它也将成为未来内容创作的重要工具,带动整个视频制作行业的变革。对于初学者来说,掌握AI视频创作工具,理解生成模型的基本原理,将有助于提高创作效率,开启更多创作可能性。

如果你也想要尝试一下这项技术,可以通过本文提到的移乐AI在线平台体验一下!